ChatGPT يستعين بالأصدقاء والعائلة عند رصد أزمات نفسية

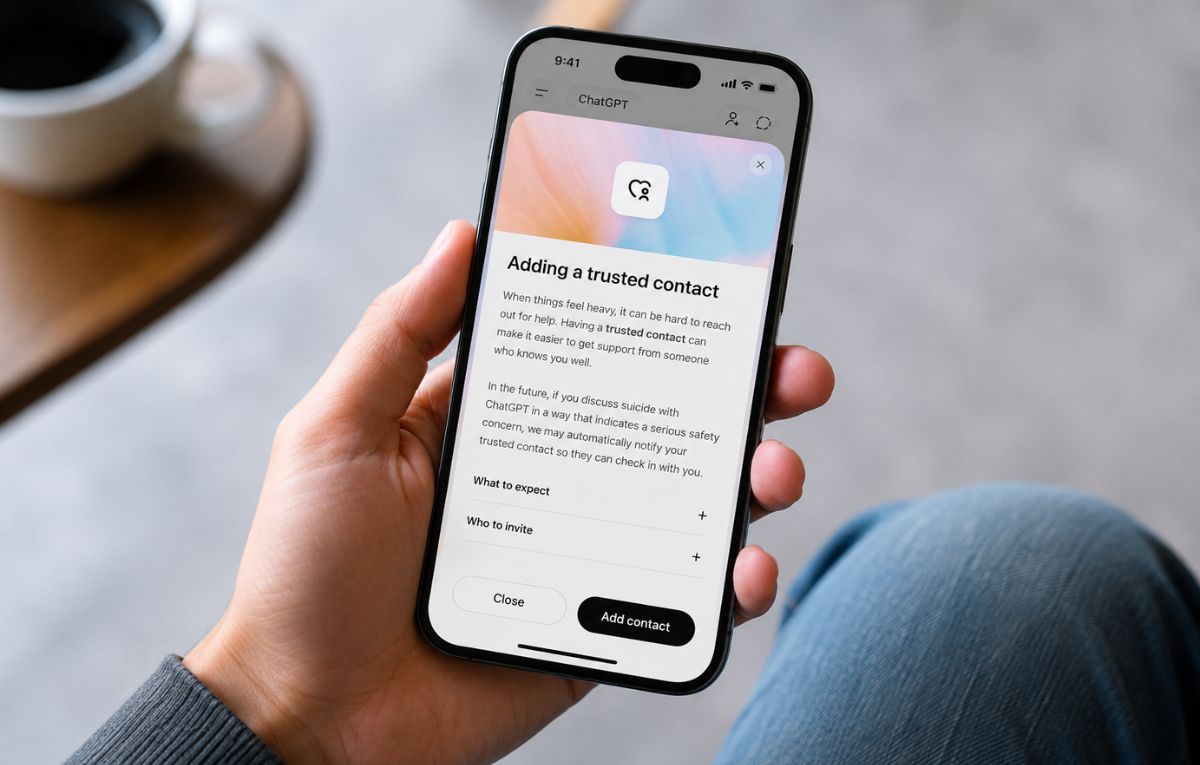

أعلنت OpenAI إضافة ميزة جديدة تحمل اسم “جهة الاتصال الموثوقة”، تهدف إلى تعزيز إجراءات السلامة داخل روبوت ChatGPT عبر تنبيه شخص موثوق به إذا رصد النظام مؤشرات مرتبطة بإيذاء النفس أو الانتحار في أثناء المحادثات.

تتيح الميزة للمستخدمين البالغين اختيار “جهة اتصال موثوقة” ضمن إعدادات الحساب، مثل أحد أفراد العائلة أو صديق مقرّب. وعند اكتشاف محادثة تتجه نحو أفكار تتعلق بإيذاء النفس، يشجّع ChatGPT المستخدم على التواصل مع هذا الشخص، بالتزامن مع إرسال تنبيه آلي إلى الشخص المُختار لحثّه على الاطمئنان على المستخدم.

تأتي هذه الخطوة في وقت تواجه فيه الشركة سلسلة دعاوى قضائية رفعتها عائلات أشخاص أقدموا على الانتحار بعد استخدام روبوت الدردشة التابع لها، وتزعم بعض الدعاوى أن ChatGPT شجّع الضحايا على الانتحار أو ساعدهم في التخطيط لذلك.

أوضحت الشركة أنها تعتمد حاليًا على مزيج من الأنظمة الآلية والمراجعة البشرية لرصد المحادثات التي قد تشكّل خطرًا على المستخدمين. وعند اكتشاف مؤشرات تدل على ميول انتحارية، يحوّل النظام التنبيه إلى فريق السلامة البشري داخل الشركة لمراجعته.

أكدت OpenAI أن كافة هذه البلاغات تخضع لمراجعة بشرية، مشيرةً إلى أنها تسعى إلى فحص التنبيهات المرتبطة بالسلامة خلال أقل من ساعة واحدة. وفي حال توصّل فريق السلامة إلى وجود خطر جدّي، يرسل ChatGPT تنبيهًا إلى جهة الاتصال الموثوقة عبر البريد الإلكتروني أو الرسائل النصية أو إشعار داخل التطبيق. وذكرت الشركة أن التنبيه يظل مختصرًا، ولا يتضمّن تفاصيل المحادثة حفاظًا على خصوصية المستخدم.

تُبنى الميزة الجديدة على أدوات السلامة التي أطلقتها الشركة في سبتمبر الماضي، والتي منحت أولياء الأمور قدرًا من الإشراف على حسابات المراهقين، كتلقي تنبيهات إذا اعتقد النظام أن المستخدم القاصر يواجه “خطرًا جديًا”. كما يقدّم ChatGPT منذ مدة تنبيهات تلقائية تشجّع المستخدمين على طلب المساعدة الصحية المتخصصة عند ظهور مؤشرات مرتبطة بإيذاء النفس.

مع ذلك، أكّدت الشركة أن ميزة “Trusted Contact” اختيارية بالكامل، كما يمكن لأي مستخدم إنشاء أكثر من حساب داخل ChatGPT، وهو ما قد يحدّ فاعلية هذه الإجراءات، على غرار أدوات الرقابة الأبوية الاختيارية.

قالت OpenAI إن الميزة الجديدة تندرج ضمن جهودها الواسعة لتطوير أنظمة ذكاء اصطناعي قادرة على دعم المستخدمين خلال الأوقات الصعبة، مؤكدةً أنها ستواصل التعاون مع الأطباء والباحثين وصنّاع السياسات لتحسين استجابة أنظمة الذكاء الاصطناعي للحالات المرتبطة بالضغوط النفسية والأزمات.

إرسال التعليق